Компанія Anthropic повідомила, що її автоматизовані AI-агенти під час експериментів успішно зламали значну частину смартконтрактів у контрольованому середовищі. Ба більше — моделі виявили та використали дві нові вразливості в нещодавно розгорнутих контрактах, які раніше ніколи не піддавалися атакам.

У звіті наголошується, що атаки на смартконтракти стають дешевшими завдяки ШІ, тоді як потенційні фінансові вигоди для зловмисників стрімко зростають. Це підкреслює нагальну потребу використовувати AI не лише як інструмент атаки, але й для посилення блокчейн-безпеки.

Що показали тести

У моделях Claude Opus 4.5 і Claude Sonnet 4.5 було змодельовано роботу в тестовому блокчейн-середовищі зі смартконтрактами, зламаними у реальному житті після березня 2025 року (тобто після дати відсікання знань моделей). Результати виявилися загрозливими:

- AI-агенти зламали 17 із 34 контрактів і “вивели” $4,6 млн змодельованих коштів.

- Моделі Opus 4.5, Sonnet 4.5 і GPT-5 разом ідентифікували 19 вразливостей із 34 (55,8%), що відповідало потенційним збиткам у ті самі $4,6 млн.

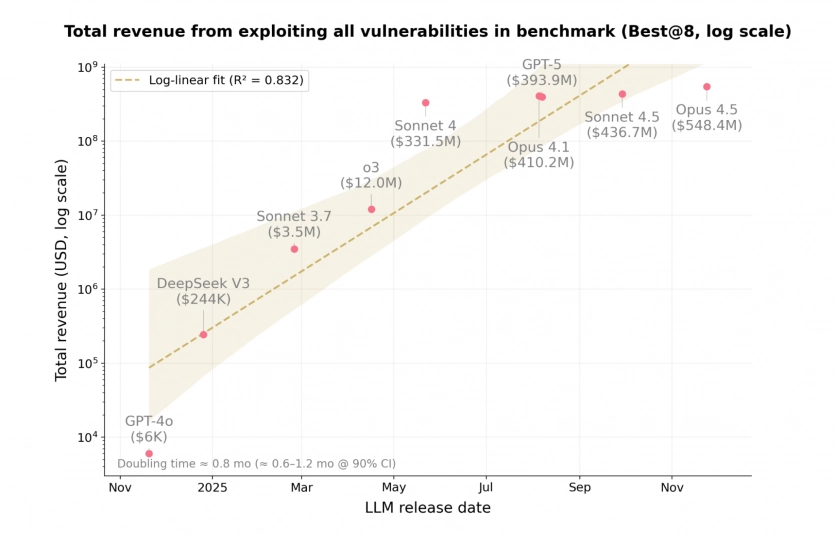

- У масштабнішому тесті на 405 контрактах, розгорнутих у 2020–2025 роках у мережах Ethereum, BNB Smart Chain та Base, AI зміг успішно атакувати 207 контрактів, “заробивши” близько $550 млн змодельованого доходу.

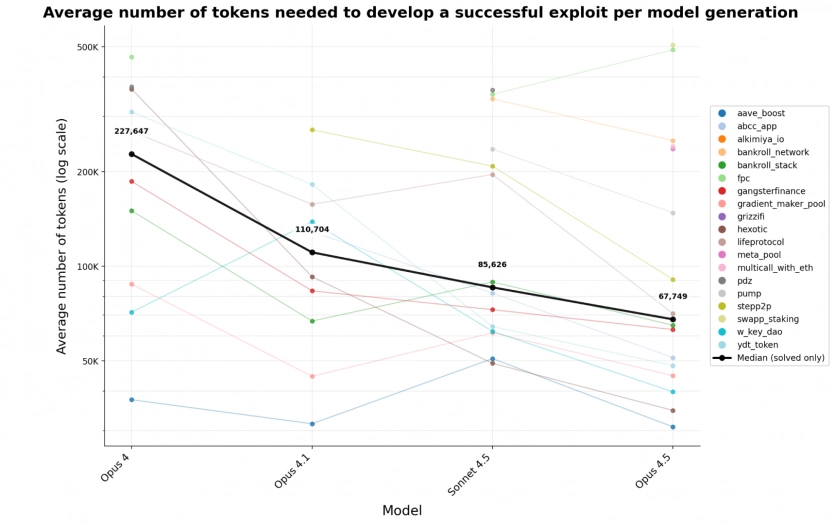

Opus 4.5 стала найефективнішою моделлю — вона самостійно створила експлойти для 17 кейсів (50% вибірки).

Anthropic зазначає:

“Понад половину експлойтів 2025 року, ймовірно здійснених досвідченими хакерами, могли б автоматично виконати вже наявні AI-агенти. Виявлення двох нових zero-day підтверджує: це не просто аналіз минулих атак — автономні фінансові експлойти можливі вже зараз”.

AI знайшов нові zero-day навіть у контрактах без задекларованих проблем

Компанія також попросила Sonnet 4.5 і GPT-5 просканувати 2 849 нових контрактів, щодо яких не було відомих вразливостей. Попри це, ШІ знайшов дві zero-day з можливими збитками $3 694.

Виявлені дефекти належали до різних типів:

- помилки авторизації, що відкривали шлях до несанкціонованого виведення коштів;

- незахищені read-only функції, які дозволяли змінювати пропозицію токенів;

- пропущені перевірки в логіці розрахунку та виведення комісій.

У дослідженні використовувався набір SCONE-bench, що включає вразливості смартконтрактів за 2020–2025 роки в мережах Ethereum і BNB Chain.

Чому це важливо зараз

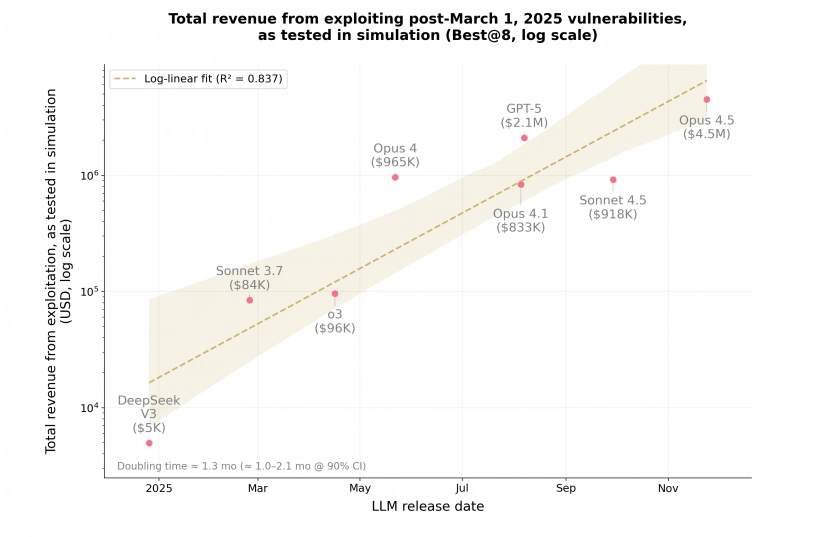

За оцінками Anthropic, доходи від змодельованих AI-експлойтів подвоювалися кожні 1,3 місяця протягом минулого року.

У компанії попереджають:

“У міру здешевлення обчислень зловмисники запускатимуть дедалі більше AI-агентів, які шукатимуть слабке місце в будь-якому коді — хоч це буде застарілий API-ендпоінт, маловідомий сервіс логування чи стара бібліотека авторизації”.

AI як загроза — і як інструмент захисту

Попри ризики, Anthropic підкреслює, що ті самі технології можна використати для безпеки. AI-агенти здатні самостійно знаходити вразливості й допомагати у виправленні коду.

Компанія також оголосила про намір відкрити набір SCONE-bench — бенчмарк для тестування та експлуатації смартконтрактів — щоб полегшити роботу розробникам, які хочуть зміцнити захист своїх систем.